Epoch AI tarafından geliştirilen bir simülatör, GPT-4 ölçeğinde bir yapay zekâ modelinin 2012 yılında kullanılan grafik işlemcilerle (GPU) eğitilebileceğini ortaya koydu. Ancak bu işlem, modern GPU’lara kıyasla on kat daha yüksek maliyet gerektirirdi. Araştırma, donanım gelişiminin büyük dil modellerinin eğitim süreçlerindeki önemini vurguluyor.

Verimlilik ve FLOP Kullanımı

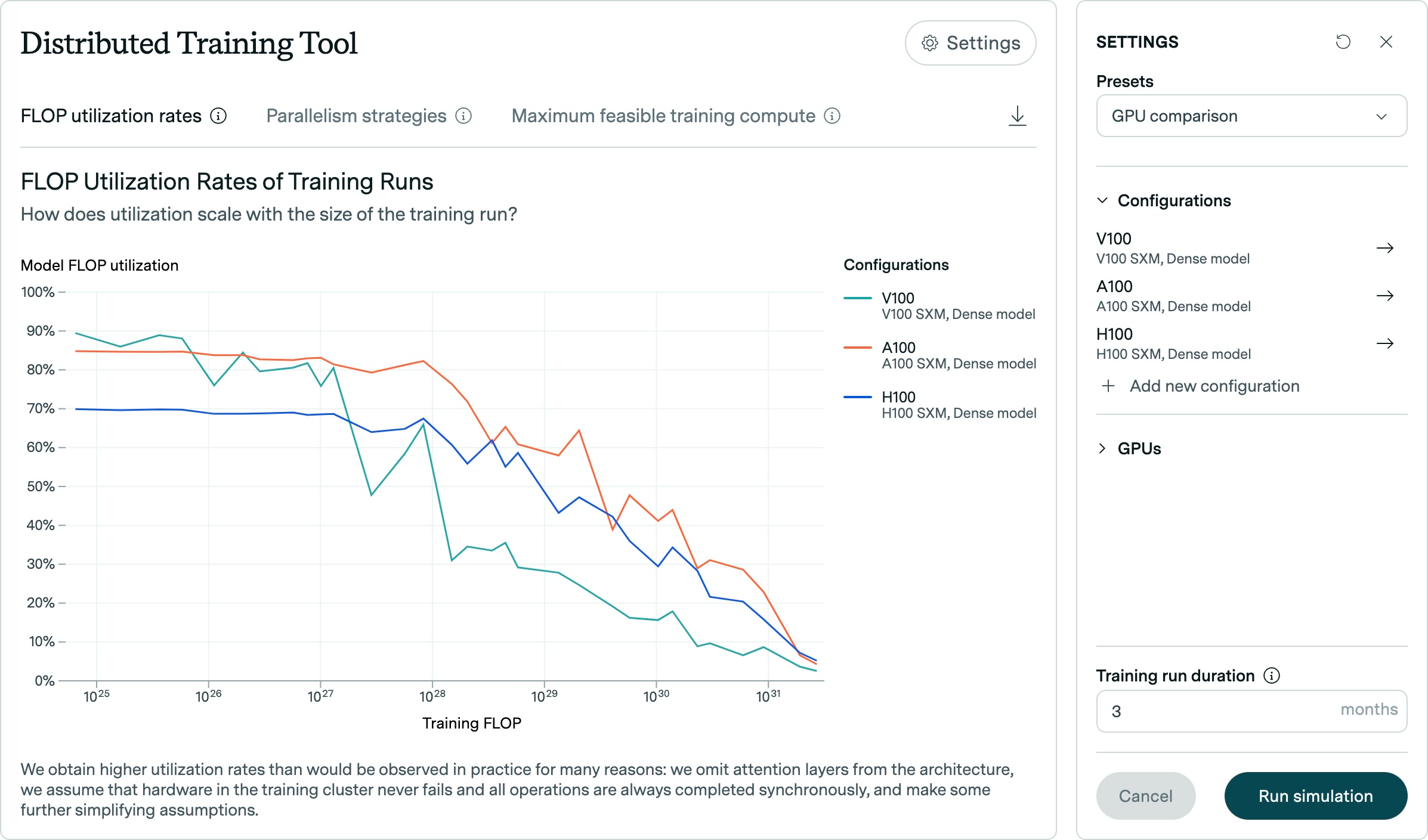

GPT-4’ün eğitimi için tahmini olarak 1e25 ila 1e26 arasında FLOP (Floating Point Operations) gerekiyor. Epoch AI’nin simülatörü, FLOP kullanım verimliliğini analiz ederek, eski ve yeni GPU’ların büyük ölçekli model eğitimlerinde nasıl bir performans sunduğunu değerlendirdi. Eski modellerden biri olan GTX 580, AlexNet’in eğitimi için 2012’de kullanılmıştı ve Epoch AI’nin simülasyonu bu kartın, GPT-4’ü eğitmek için gerekli işlemleri gerçekleştirebileceğini, ancak modern GPU’ların sunduğu verimlilikten çok uzak olduğunu gösterdi. Daha yeni mimariler, aynı işlem gücünü çok daha düşük enerji tüketimiyle sağlayabiliyor.

V100, A100 ve H100’ün farklı verimlilik eğrileri var; daha yeni H100 ve A100 mimarileri yüksek kullanım oranlarını daha uzun süre koruyabiliyor. | Görsel: Epoch AI

GPU Gelişimindeki Farklılıklar

Araştırmada, H100, A100 ve V100 GPU modellerinin verimlilik eğrileri karşılaştırıldı. Yeni mimariler (H100 ve A100), eğitim boyunca yüksek FLOP kullanım oranlarını koruyabilirken, V100 gibi eski modeller daha hızlı verim kaybı yaşadı. Bu fark, donanım mimarisindeki gelişmelerin büyük modellerin eğitimi üzerindeki maliyet ve hız avantajını açıklıyor.

Epoch AI’nin simülatörü, aynı zamanda farklı GPU nesillerinin eğitim süreçlerinde ne kadar etkili olduğunu belirlemek için de kullanılıyor. Örneğin, H100 GPU’ları, A100 ve V100 modellerine kıyasla daha büyük veri setlerini ve daha karmaşık modelleri daha hızlı işleyebiliyor.

Eski GPU’larla Eğitim Maliyeti

2012 yılında kullanılan GTX 580 gibi GPU’lar, GPT-4 seviyesindeki bir modeli eğitmek için yeterli FLOP kapasitesine sahip olsa da, bu işlem inanılmaz derecede pahalı olurdu. Epoch AI, bu tür bir eğitimin, modern GPU’lara kıyasla yaklaşık on kat daha yüksek maliyet gerektireceğini belirtti. Modern GPU mimarileri, enerji tüketimini azaltırken işlem kapasitesini artırıyor ve eğitim süreçlerini daha uygun maliyetli hale getiriyor.

Gelecekteki Donanım İhtiyaçları

Epoch AI’nin simülatörü, yalnızca mevcut donanımın performansını değerlendirmekle kalmıyor, aynı zamanda gelecekteki donanım ihtiyaçlarını anlamaya da olanak tanıyor. Simülatör, büyük ölçekli model eğitimlerinin farklı veri merkezlerine nasıl dağıtılabileceğini, bağlantı gecikmesi ve bant genişliği gibi değişkenlerin performansı nasıl etkileyebileceğini simüle ediyor. Bu da, büyük yapay zekâ projelerinin lojistik ve teknik planlamalarını optimize etmeye yardımcı oluyor.

Neden Önemli?

Epoch AI’nin çalışması, büyük ölçekli yapay zekâ modellerinin donanım gereksinimlerini anlamak için önemli bir araç sunuyor. Ayrıca, farklı GPU nesillerinin verimliliği üzerindeki bu analiz, yapay zekâ gelişiminde enerji verimliliği ve maliyet optimizasyonunun ne kadar kritik olduğunu bir kez daha gösteriyor. Bu araştırma, donanım kısıtlamalarının aşılması ve gelecekte daha büyük modellerin eğitimi için yeni yöntemler geliştirilmesi açısından önemli bir adım olarak değerlendiriliyor.

Sonuç olarak, 2012 yılında mevcut olan teknolojilerle GPT-4 ölçeğinde bir model eğitmek teknik olarak mümkün olabilirdi, ancak bu süreç, bugünün modern donanımlarıyla kıyaslandığında çok daha pahalı ve zaman alıcı olurdu. Modern GPU mimarileri, yapay zekâ araştırmalarında maliyetleri azaltma ve verimliliği artırma konusunda devrim yaratmaya devam ediyor.

Comments are closed